OpenClaw搭建指南:从零开始构建高效自动化抓取系统

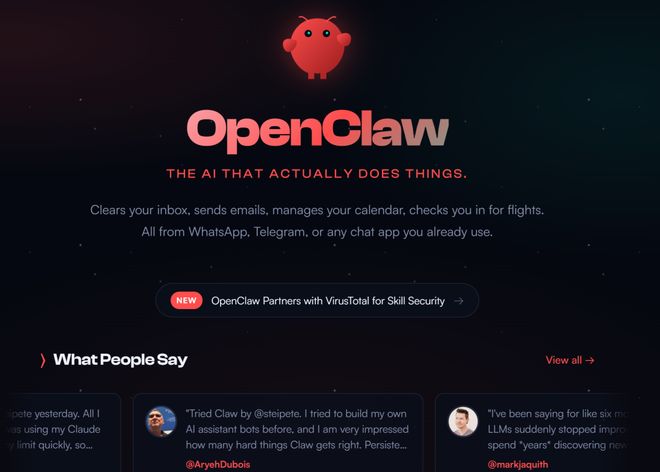

OpenClaw: 真正帮你完成任务的 AI 助手 | 开源 AI 自动化工具。

在当今数据驱动的时代,高效获取网络信息的能力至关重要。OpenClaw作为一个开源的网络抓取框架,为开发者和数据分析师提供了强大的工具。本文将深入探讨如何从零开始搭建OpenClaw系统,并分享关键步骤与优化技巧。

搭建OpenClaw前,需要明确项目需求。您是否需要进行大规模数据采集,还是针对特定网站进行精准抓取?确定需求后,便可开始准备环境。OpenClaw基于Python开发,因此确保系统已安装Python 3.7及以上版本是首要步骤。同时,安装必要的依赖库,如requests、BeautifulSoup和Scrapy框架,这些工具将大大简化开发流程。

接下来,配置OpenClaw的核心组件。这包括设置用户代理、处理Cookie管理以及实现IP轮换机制,以避免被目标网站封锁。合理的延迟设置和并发控制不仅能提升抓取效率,还能体现对目标网站服务器的尊重,符合网络爬虫道德规范。此外,编写健壮的解析器是成功的关键,需考虑网页结构变化时的容错处理。

数据存储方案同样重要。OpenClaw支持多种数据库,如MySQL、MongoDB或简单的CSV文件。根据数据量和查询需求选择合适存储方式,并设计高效的数据清洗流程,确保获取信息的质量。最后,部署监控系统来跟踪抓取任务状态,及时发现并解决异常,保障系统长期稳定运行。

通过以上步骤,您不仅能成功搭建OpenClaw系统,还能根据实际需求进行深度定制。无论是市场研究、竞争分析还是学术数据收集,掌握OpenClaw搭建技术都将为您打开数据世界的大门。记住,合法合规地使用网络抓取工具,尊重robots协议,是每个技术开发者应尽的责任。