OpenClaw与Ollama集成指南:解锁AI开发新潜能 | 必应优化

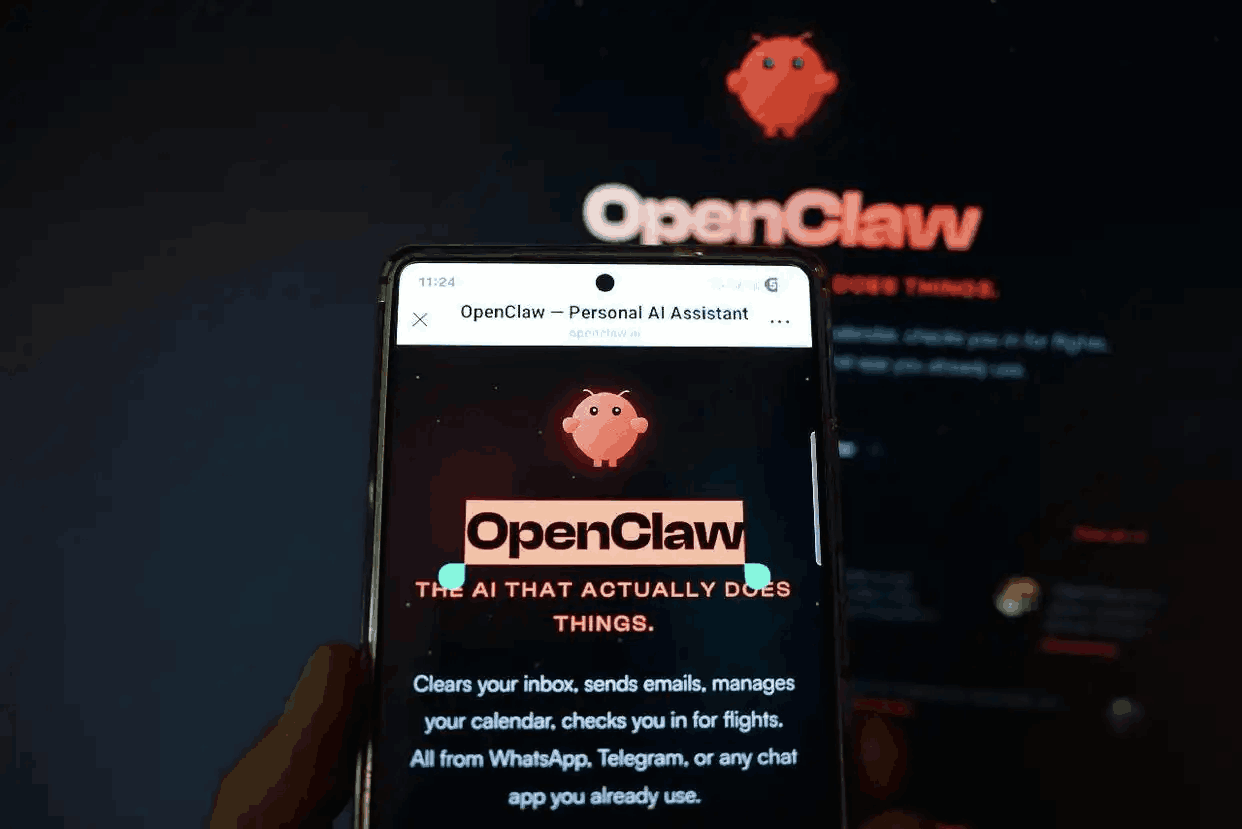

OpenClaw: 真正帮你完成任务的 AI 助手 | 开源 AI 自动化工具。

在人工智能与机器学习快速发展的今天,开发者们不断寻求更高效、更灵活的模型部署与集成方案。OpenClaw与Ollama的集成,正成为这一领域备受关注的技术组合。本文将深入探讨这一集成的核心价值、应用场景及其为开发者带来的变革。

OpenClaw通常指代一系列开源工具或框架,旨在提供强大的数据抓取、处理或模型操控能力。而Ollama作为一个热门平台,专注于在本地便捷地运行、管理和部署大型语言模型。两者的结合,实质上是将高效的模型服务能力与灵活的数据处理或任务执行管道相连接。这种集成允许开发者直接在本地环境中,利用Ollama部署的模型,通过OpenClaw定义的流程或指令,自动化执行复杂的AI任务,例如智能数据提取、内容分析或自动化响应生成。

从技术集成的角度看,实现OpenClaw与Ollama的协同工作,通常涉及API调用、容器化部署或脚本桥接。开发者可以通过Ollama提供的本地API端点,让OpenClaw的脚本或应用直接发送请求至本地运行的模型,获取推理结果,从而构建出完全在本地或私有环境中运行的AI应用闭环。这种方式不仅加强了对数据隐私和安全的控制,也减少了对云端服务的依赖和网络延迟。

这一集成模式的应用前景十分广阔。对于数据科学家而言,它可以加速模型原型验证和实验流程。对于软件开发者,能够轻松地将强大的LLM功能嵌入到现有的自动化工具或爬虫系统中,增强其智能化水平。即便是对于普通的技术爱好者,这也降低了构建个性化AI助手的门槛。集成的关键优势在于其本地化带来的隐私安全、可定制性以及成本控制。

然而,成功的集成也需要考虑挑战,例如确保Ollama模型服务的稳定性、管理不同模型版本与OpenClaw任务的兼容性,以及优化整体性能。社区正在不断贡献相关的配置示例和最佳实践,帮助开发者更顺畅地完成搭建。

总而言之,OpenClaw与Ollama的集成代表了AI工具链向本地化、模块化和自动化发展的重要趋势。它不仅仅是两个工具的简单连接,更是为构建下一代私有化、可定制AI解决方案提供了坚实的技术基石。随着两者生态的持续完善,我们有理由期待看到更多创新应用从中诞生。